【图/文 贺睿】

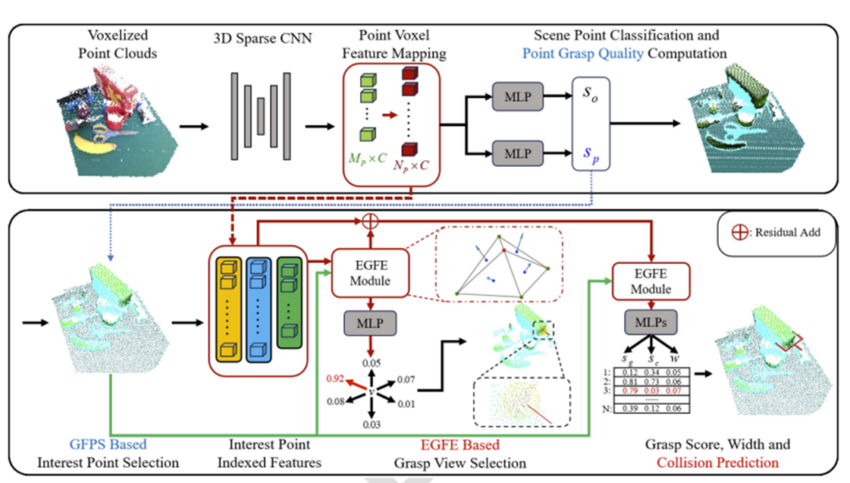

本工作面向通用机 械臂的六自由度抓取位姿检测任务,针对当前基于点云的抓取位姿检测算法中存在的场景采样和特征提取问题,本文提出了一种新的感兴趣点提取方式和局部点云显式特征提取算法,并设计了如图1所示的实时高精度的六自由度抓取位姿检测网络。在GraspNet1Billion数据集上的结果显示,我们的方法与GSNet, MS-Fusion等SOTA方法相比,在Test Seen/Similar/Novel所有测试子集上展现了更优越的检测精度,如图2所示。

图1

图2

此外,我们在一台UR5e机械臂上验证了我们抓取算法的实用性。我们选取了八类测试物体,其中绝大多数从未在GraspNet1Billion数据集中出现。在单物体抓取场景中,我们的抓取位姿检测算法在六类物体的抓取中取得了100%的成功率,对于另外两类物体实现了90%的成功率。在多物体抓取场景中,我们的算法在五个场景下取得了100%的抓取成功率,在另外一个场景下取得了85.7%的成功率。单物体和多物体场景抓取效果如下:

细节请关注如下论文:

R. He, H. Chen and M. Fu, “Interest Point Selection and Feature Extraction in Six-DoF Grasp Pose Detection,” in IEEE/ASME Transactions on Mechatronics, online, 2024, doi: 10.1109/TMECH.2024.3385104